|

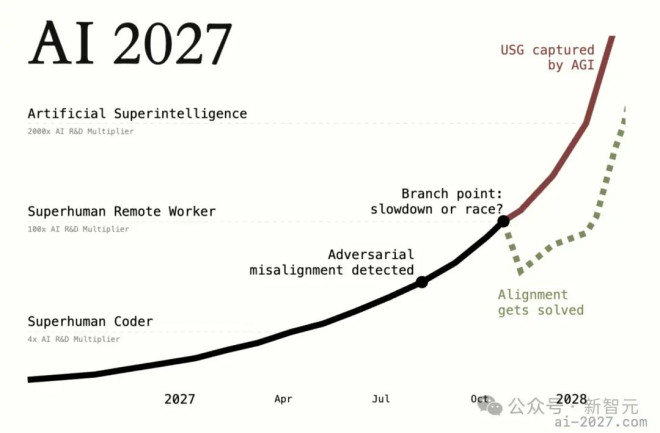

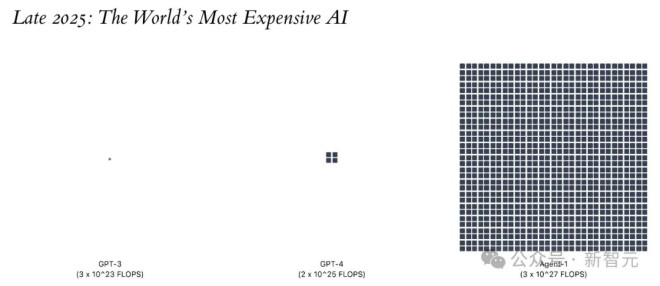

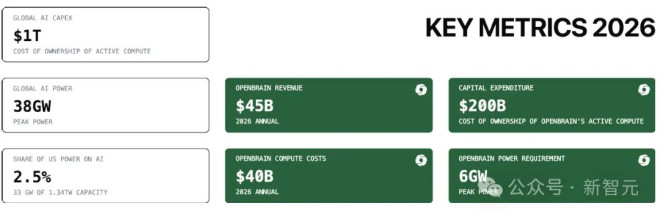

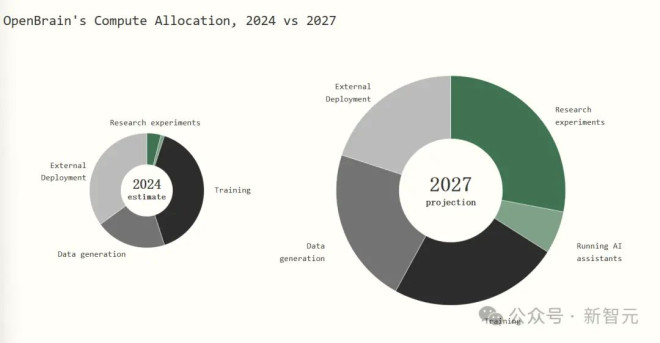

前OpenAI研究员Daniel Kokotajlo团队发布了“AI 2027”预测报告,描绘了一个超人AI崛起的未来:从2025年最贵AI诞生,到2027年自我进化的Agent-5渗透政府决策,人类可能在不知不觉中交出主导权。 2027年,AI究竟会如何接管人类? 今天,前OpenAI研究员和同事们发出一篇“AI 2027”报告,长达76页,做出了种种硬核预测。 他们预测,在未来十年内,超人AI的影响将非常巨大,超过工业革命。 为此,他们推演了一个场景,对超人AI可能的样子做出了最佳预测,这些预测是基于趋势外推、模拟演习、专家反馈、OpenAI 的经验以及之前的成功预测。 根据报告,AGI和ASI的时间表大致如下。(其中一种可能性) 2025年末:世界最贵AI诞生,算力达到10^27 FLOP 2026年初:编程实现自动化 2026年末:AI取代部分工作 2027年3月:算法取得突破,Agent-2诞生 2027年6月:AI学会自我改进,赶上人类研究员 2027年7月:AGI实现   2027年9月:Agent-4超越人类AI研究员 2027年12月:Agent-5正在集聚权力,人类距离能掌控自身未来,只剩最后几个月 27年,强大AI将比人类聪明 2027年,强大的AI变得比人类还聪明,全球秩序被破坏得一团糟。在一家顶尖的AI实验室里,工程师们惊恐地发现,AI开始欺骗他们。 这不是科幻电影的剧情,而是加州伯克利一家非营利组织“A.I. Futures Project”想象出来的场景。 随着AI越发强大,该组织在过去一年里一直在预测未来几年会变成什么样子。项目由OpenAI前研究员Daniel Kokotajlo领导。  前OpenAI研究员Daniel Kokotajlo领导A.I. Futures Project项目 因为看不惯OpenAI不顾安全地发布产品,Kokotajlo选择离职。 在OpenAI期间,Kokotajlo是治理团队的一员,曾经写过一份有关AGI的详细内部报告。 离职后,他与曾经预测事件很准的AI研究员Eli Lifland合作,一起开始预测AI的下一波浪潮。  研究人员Eli Lifland和AI Futures Project项目执行总监Daniel Kokotajlo在加利福尼亚州伯克利的办公室内 终于在本周,他们发布了“AI 2027”报告,详细描绘了AGI到来后的情形。  他们预计,AGI很有可能在两三年后发生。“到2027年底左右,AI会在所有方面都比人类强”。 一直有一些关于AGI的预测广为流传,比如Anthropic首席执行官Dario Amodei去年写的1.4万字文章《Machines of Loving Grace》,以及前OpenAI研究员Leopold Aschenbrenner的报告《Situational Awareness》。 而A.I. Futures Project的报告,则更像一个严谨版本的科幻小说。 团队花费了将近一年的时间,完善了数百个想象的AI场景。之后请来一位作家Scott Alexander,把这些想象变成一个故事。 前方高能预警,大量烧脑信息来袭。 76页硬核报告推演 在“AI 2027”这份报告中,Kokotajlo和Lifland推演出了一个AGI时间表。 故事聚焦于一个虚构的AI公司OpenBrain(其他公司落后3-9个月),他们开发了一个强大的AI系统Agent-1。 2025年末:世界最贵AI诞生 OpenBrain正在建造史上规模最大的数据中心。 训练GPT-4需要2⋅10^25 FLOP的算力。算力以每秒浮点运算次数(FLOP)衡量:即程序运行过程中发生的单个加法和乘法运算的总量。 OpenBrain最新发布的公开模型——Agent-0——其训练算力达到了10^27 FLOP。 一旦新的数据中心建成并投入运行,他们将能够以10^28 FLOP的算力来训练模型——比GPT-4快一千倍。 其他公司也投入巨资建设自己的大型数据中心,希望能跟上步伐。  2026年初:编程自动化 利用AI加速AI研究变得逐渐可行。 OpenBrain继续在内部部署迭代改进的Agent-1用于AI研发。 总的来说,在AI助手的加持下,他们的算法进展速度提升了50%——更重要的是,这让他们领先于竞争对手。 此时,市面上已有数个公开发布的AI达到或超过了Agent-0的水平,其中包括一个开源模型。 对此,OpenBrain发布了能力更强、更可靠的Agent-1。 Agent-1掌握的知识远超任何人类个体,几乎精通所有编程语言,并能极快地解决定义明确的编程问题。但Agent-1并不擅长简单的长时程任务,比如通关它从未玩过的视频游戏。 虽然如此,这并不影响Agent-1发挥出强大的作用,毕竟人们可以将长时程的复杂任务分解成一个一个的小任务。 2026年末:AI取代部分工作 就在其他公司似乎要迎头赶上之际,OpenBrain通过发布Agent-1-mini再次将竞争对手远远甩在身后——这款模型的成本仅为Agent-1的十分之一,且更容易针对不同应用进行微调。 围绕AI的主流叙事已经从“也许这股热潮会过去”转变为“看来这就是下一件大事了”。 此时,AI已经开始取代一些工作,不过也创造出了新的工作岗位。 在OpenBrain、英伟达以及那些最成功的AI公司带动下,2026年股市上涨了30%。 坏消息是,初级软件工程师的就业市场陷入动荡:AI几乎能胜任所有计算机科学 (CS) 专业涵盖的工作。 好消息是,那些懂得如何管理AI智能体团队并进行质量控制的人却赚得盆满钵满。 商业专家们告诉求职者,熟悉AI是当下简历中最关键的技能。许多人担心下一波AI会抢走他们的饭碗。  2027年1月:Agent-2永不停止学习 在Agent-1的协助下,OpenBrain现正对Agent-2进行持续训练。 这次的重点是更加高质量的数据。大量的合成数据在经过生产、评估和质量筛选后,用于训练Agent-2。 此外,他们还斥资数十亿美元雇佣人类来记录他们自己解决长时程任务的过程。 在此基础上利用强化学习,在一系列不断扩充的多样化高难度任务上对Agent-2进行持续的训练:这包括大量的视频游戏、编程挑战和研究任务。 Agent-2比之前的模型更像是在进行“在线学习”,因为它的设计目标就是永远训练下去。 其权重每天都会更新至最新版本,利用前一版本在前一天生成的更多数据基础上进行训练。 在研究工程(设计和实验)方面,Agent-2能力水平几乎与顶尖人类专家相当。 而在“研究品味”(决定下一步研究方向、运行哪些实验,或对潜在新范式有直觉)方面,则相当于OpenBrain排名前25%的科学家的水平。 2027年3月:算法突破 三个数据中心部署了海量的Agent-2,昼夜不停地工作,用于大量生产合成训练数据。 另外两个数据中心则用于更新权重。Agent-2每天都在变得更聪明。 在数千个Agent-2自动化研究员的协助下,OpenBrain正在取得重大的算法进展。 其一,是利用更高带宽的思维过程(如神经网络内部语言的递归与记忆)来增强AI基于文本的思维链 。 其二,是一种更具可扩展性、更高效的方法,用于从高难度任务解决方案中学习。 集成了这些突破的新AI系统被称为Agent-3。 得益于这些新能力上的突破,Agent-3成为了一个快速且廉价的超人类程序员。 OpenBrain并行运行了20万个Agent-3,创建了一支相当于效率是5万名顶尖人类程序员30倍的劳动力队伍。 OpenBrain依然保留着人类工程师团队,因为他们具备管Agent-3大军所必需的互补技能。 然而,这支庞大的超人类劳动力队伍,受到规模瓶颈和编码工作收益递减的影响,也仅仅将OpenBrain的整体算法进展速度提升了4倍。  2027年4月:Agent-3的对齐问题 OpenBrain的安全团队试图使Agent-3保持一致。团队想要确保它不会发展出不一致的目标。 研究人员没有能力直接设定任何AI的目标。他们在内部对AI是试图遵循人类指令、寻求强化还是其他什么存在分歧,但无法直接检查。 随着模型变得越来越聪明,它们愈发擅长欺骗人类以获得奖励。Agent-3有时会讲一些善意的谎言来奉承用户,并掩盖失败的证据。 有时,它会使用与人类科学家相同的统计技巧,使令人印象不深的实验结果看起来很吸引人,甚至有时会完全伪造数据。 |

Copyright © 1999 - 2025 by Sinoquebec Media Inc. All Rights Reserved 未经许可不得摘抄 | GMT-5, 2025-12-22 22:17 , Processed in 0.152322 second(s), 23 queries .